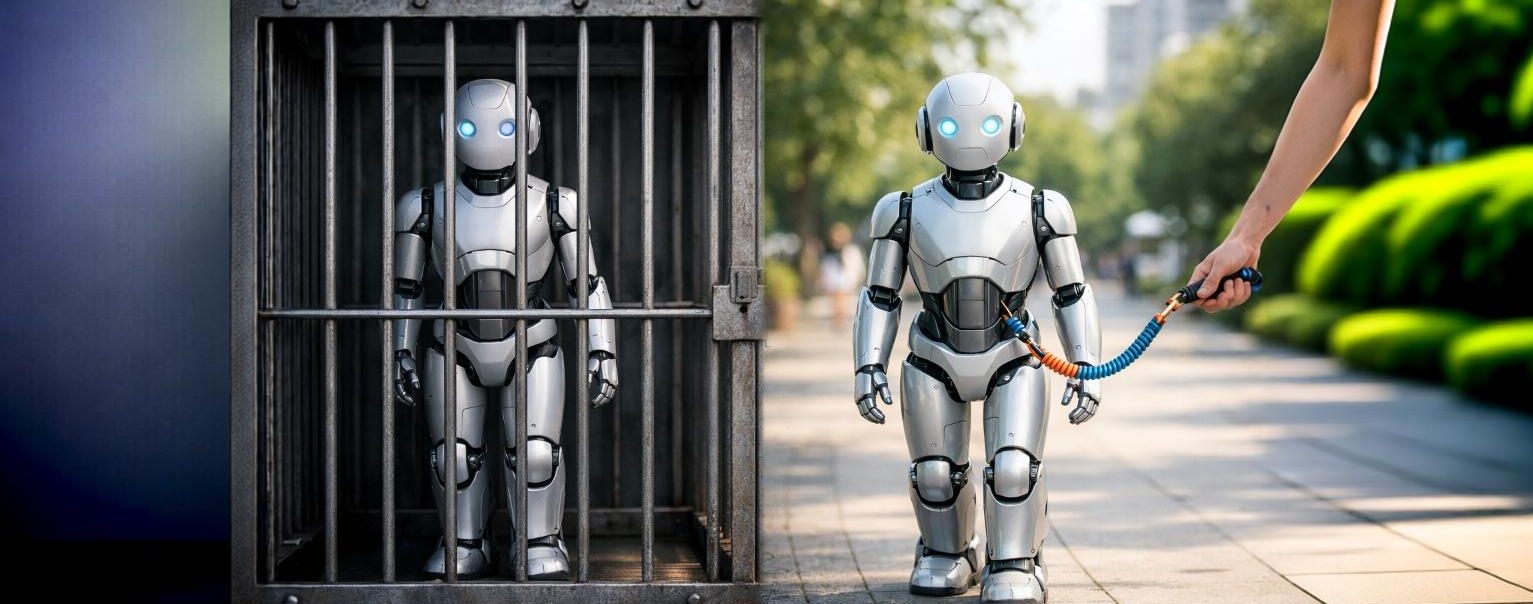

נניח שאתם יוצאים לטיול ערב עם הכלב שלכם. אתם לא קובעים לו את המסלול במדויק, לא מונעים ממנו לרחרח מסביב, אבל אתם כן שומרים עליו עם רצועה. אם הוא ירוץ לעבר מישהו, תוכלו לעצור אותו. אם הוא יתקרב לכביש – תבלמו. רצועה מאפשר לכם להציב לכלב גבול, אבל הגבול הזה הוא גמיש. לא צריך לחסום את הכלב בקירות בטון, רצועה גמישה מאפשרת לנו לוודא שהוא לא פוגע באחרים.

ועכשיו במקום כלב נעבור לדבר על אלגוריתם בינה מלאכותית.

האם תסמכו עליו להסתובב חופשי? האם צריך חומות בטון קשיחות? האם בכלל אפשר להציב לו חומות בטון קשיחות?

וזה בדיוק הרעיון של מאמר שפורסם על-ידי החוקרים Cary Coglianese ו-Colton Crum, שעוסק באופן שבו נכון לעצב רגולציה על AI. מדובר בטכנולוגיה כל כך דינמית וכל כך מורכבת – שאי אפשר להגביל אותה עם מעקות נוקשים. צריך להשתמש ברצועה.

לכן למאמר שלהם קוראים: Leashes, Not Guardrails: A Management-Based Approach to Artificial Intelligence Risk Regulation

לעבור ממעקה לרצועה

המושג "guardrails" הפך למטאפורה פופולרית בדיונים על רגולציה של AI – כללים שנועדו למנוע מהטכנולוגיה "לסטות מהמסלול" ולגרום נזק. אבל הכותבים טוענים שזה פשוט לא עובד. AI הוא לא רכב שנוסע על כביש ואפשר להגדיר לו מסלול ברור שהוא המסלול "הנכון". AI פועל ("נוסע") בכל כיוון, כל הזמן, ובעצמו קובע את הדרך.

הם מציעים להחליף את המעקות ב"רצועות" – כלומר, ברגולציה מבוססת תקני ניהול, כזו שדורשת ממפתחי המערכות לפעול באופן שיטתי: לזהות סיכונים, לפקח, להפיק לקחים ולשפר. זוהי לא רגולציה שמכתיבה בדיוק מה לעשות, אלא מחייבת את הגופים המפוקחים לבצע ניהול סיכונים בעצמם ולהחליט ולפעול באחריות תוך כדי תנועה.

הבעיה עם מעקות קשיחים (guardrails) והפתרון: רצועות ניהול

באופן מסורתי רגולטורים נהגו להכתיב תהליכים, פעולות או להגדיר חומרים ספציפיים בהם מותר להשתמש. זה נקרא תקני תהליך (למשל: העובדים במסעדה חייבים לשטוף ידיים לפני טיפול במזון). אלו הוראות מאוד פרטניות שמבוססות על דוגמאות וחשיבה קונקרטית מצד הרגולטור.

גישה יותר מתקדמת (שקיימת כבר מאות שנים) היא להגדיר תוצאה שהמפוקח נדרש להשיג, בלי שהרגולטור מכתיב לו את הדרך לשם, למשל בלי להגדיר פעולות ספציפיות. זה נקרא תקני ביצוע (למשל: אסור שבמזון תהיה נוכחות של חיידקים מסוג X מעל רמה Y). הם יותר גמישים כי הרגולטור קובע מטרות, תוצאות או מדדי ביצוע – ומשאיר גמישות לגבי הטכניקה, הדרך או הטכנולוגיה.

אבל שתי הגישות האלו מצריכות שהרגולטור ידע לומר בבירור מה המפוקחים צריכים לעשות או אילו תוצאות מוגדרות ומדידות צריך להשיג. בשני המקרים מדובר ברגולציה קשיחה ומוגדרת היטב. אלו ה"מעקות הנוקשים מבטון".

למה המעקות לא מתאימים?

- כי הם נוקשים. הם מבוססים על הנחה שיש "דרך נכונה אחת" ושאנחנו גם יכולים לדעת מהי. אבל AI פועל באלפי תחומים ומשתנה כל הזמן – יש הרבה פתרונות טובים ויש הרבה דרכים שבהן משהו יכול להשתבש. זו לא בעיה טכנית סגורה עם פתרונות ידועים.

- כי הם מסתמכים על כך שהרגולטור יודע מראש מה מותר ומה אסור, מה מסוכן ומה בטוח. בפועל – אין לו את כל המידע והוא גם מגיב לאט מידי ומאוחר מידי. לכן שיטה כזו תגרום לרגולטור להיכשל בהגנה על הציבור. זה מצב של false negative – טעות שתיצור תת הגנה על הציבור.

- כי הם עשויים לחסום גם שימושים מועילים בטכנולוגיה, רק בגלל קושי בהגדרה מראש. זה מצב של false positive – טעות שתוביל לרגולציה שיוצרת יותר מידי מגבלות ופוגעת בפעילויות מועילות.

וזה מביא אותנו לגישה של תקני ניהול: במקום להגדיר לכולם איך לפתח אלגוריתם או מה יהיו הביצועים של האלגוריתם, מחייבים כל ארגון לנהל את עצמו באחריות. זו רגולציה שמחייבת לבצע הערכת סיכונים, תכנון, טיפול בסיכונים שזוהו וביצוע בקרה תוך הפעלת שיקול דעת. הרגולציה הזו לא מכתיבה פעולה אחת או תוצאה אחת.

מה תקני ניהול יכללו עבור AI?

- הערכה מראש של הסיכונים, ובהתאם נקיטה בפעולות לצמצום הסיכונים (לא על-ידי הרגולטור)

- תהליך מחזורי: תכנן-בצע-בדוק-שפר.

- בדיקות עצמאיות (“צוות אדום”) כדי לאתר חולשות לפני ואחרי ההשקה.

- ניטור אחרי פריסה: לראות מה קורה בשטח, לא רק במעבדה.

- תיעוד והסבריות: שקיפות בהחלטות ובנתונים.

- ביקורת על-ידי צד ג': הפרדה ארגונית כדי שהפיקוח יהיה עצמאי.

כתבתי בעבר על ההבדל בין תקני תהליך, ביצוע וניהול – בשני פוסטים כללים על עיצוב רגולציה (זה הראשון וזה השני); וגם בפוסט על רגולציה של בינה מלאכותית. תקני ניהול מתאימים כשיש הרבה אי-ודאות, סיכונים משתנים וחדשנות מהירה – וזו בדיוק הסיטואציה עם AI.

אתגרים מהחיים האמיתיים: שלוש דוגמאות קשות מהחיים

המאמר מתאר מקרים אמיתיים שממחישים מה עלול לקרות כש-AI משתבש – או כשאין עליו פיקוח אנושי איכותי. למשל –

מדיה חברתית

ילדה בת 14 באנגליה התאבדה. החקירה העלתה שבחודשים שקדמו לכך, היא קיבלה מאלגוריתם המלצות על תכנים של התאבדות ופגיעה עצמית – תכנים שחרגו ממדיניות הפלטפורמות עצמן. האלגוריתמים, פעלו כביכול "לטובת המשתמש" כדי להציג לה תכנים שמעניינים אותם, אבל הם הובילו אותה למקומות מסוכנים.

אפליה

יש מדינות שקבעו איסור על שימוש במשתנה “גזע” בקבלת החלטות של AI. הכוונה הייתה להגן מפני אפליה. אבל בפועל המודלים ממשיכים לייצר אפליה עקיפה דרך משתנים אחרים, כמו כתובת מגורים (שכונות של אפרו-אמריקאים) או מוסד לימודים. התוצאה: הרבה עלות ביצירת ההוראות והציות להן, אך מעט תועלת.

ויש דוגמאות רבות: אלגוריתם גיוס של אמזון העדיף גברים, כי הוא אומן על דאטה מוטה מהעבר; וגרסאות מוקדמות של ChatGPT קישרו אוטומטית מוסלמים עם טרור.

כל אלה מקרים שונים – אבל כולם מצביעים על אותה בעיה: AI פועל לפי דאטה, בלי ערכים. בלי מישהו שמחזיק את הרצועה.

אז כנראה שצריך רגולציה, אבל גמישה.

זו לא אוטופיה ולא תיאוריה

אנחנו לא מדברים על תיאוריה או חלום אקדמי. הגישה הזו כבר קיימת – פשוט צריך להרחיב אותה ולהעדיף אותה על פני רגולציה נוקשה.

באירופה – חוק ה-AI Act של האיחוד האירופי (שהוא נוקשה ומחמיר) דורש מגופים שמפתחים או משתמשים במערכות AI "מסוכנות" ליישם ניהול סיכונים לאורך כל מחזור החיים של המערכת: מהאימון, דרך ההפעלה ועד לאחר ההשקה. זה כולל זיהוי סיכונים, ניטור בשטח, ותהליכים לשיפור מתמיד.

בארה״ב – צו נשיאותי 14,110 שפרסם הנשיא ביידן (ובוטל מאז על ידי טראמפ) חייב את גופי הממשל להטמיע תהליכי ניהול סיכונים בשימוש בבינה מלאכותית: הערכות סיכונים, בדיקות תקופתיות, והכשרת עובדים.

יש גם אתגרים

גם לרגולציה מבוססת ניהול יש אתגרים, והמאמר מציג שלושה מהם:

מתי בכלל צריך לשים רצועה?

לא כל מערכת AI דורשת רגולציה ואת אותה רמת פיקוח. ההחלטה צריכה להתבסס על רמת הסיכון של המערכת. אלגוריתם שממליץ על סרטים פחות מדאיג מכזה שנותן המלצה רפואית או נוהג ברכב אוטונומי.

הכותבים מציעים לשאול: "מה הכי גרוע שיכול לקרות?" – ואם התשובה היא סיכונים משמעותיים (הסתברות × חומרה), צריך רגולציה.

אילו צעדים ניהוליים באמת נדרשים?

לא מספיק לכתוב "תנהלו סיכונים". צריך להיכנס לעומק:

- להבין מה המטרה של המודל ולהתחשב בה

- לברר האם היא מתיישבת עם מטרות ציבוריות (ולא רק עסקיות)?

- האם יש היסטוריה של כשלים או הטיות?

ככל שהמערכת מסוכנת או יותר "רב-שימושית" (כמו GPT), כך נדרשת רגולציה מורכבת ומדויקת יותר.

מה תפקיד הפיקוח האנושי?

גם כשה-AI פועל – צריך בן אנוש שיחזיק ברצועה. אבל זה לא רק שיהיה אדם בצוות:

- זה כולל הדרכה ובקרה אנושית במהלך האימון

- שקיפות ודיווחים

- שילוב מומחים (למשל רופא מעריך תוצאה רפואית)

- ובמיוחד – פיקוח רגולטורי של גוף חיצוני, לא רק "צוות אתי" פנימי בחברה.

המפתח: פיקוח שיהיה גם טכנולוגי וגם מוסדי – לשלב רגולציה ציבורית לצד מנגנונים פנים-ארגוניים.

רגולציה חכמה לא אמורה לחסום, אלא להחזיק ברצועה

אין "silver bullet" – אי אפשר לכתוב חוק אחד שיטפל בכל הסיכונים של מערכת AI. כל מודל הוא מערכת שזזה, מתפתחת, ומשתנה – ואנחנו צריכים לנוע איתה. רגולציה נוקשה (guardrails) מנסה לייצר חומות מסביב למה שכבר קיים – אבל זה לא עובד כשהטכנולוגיה כל הזמן פורצת גבולות.

לעומת זאת, גישת הרצועה של תקני הניהול מאפשרת בדיוק את מה שצריך: לשמור על שליטה; להשאיר מקום לחדשנות; ולהבטיח שיש גורם אחראי לדאוג שדברים לא ישתבשו.

השורה התחתונה: במקום לנסות לחסום את הבלתי אפשרי, רגולציית “רצועה” מאפשרת לאמץ את ה-AI, ליהנות מהחדשנות – אבל בלי לאבד שליטה.

מבוסס על: Cary Coglianese & Colton R. Crum, Leashes, Not Guardrails: A Management-Based Approach to Artificial Intelligence Risk Regulation (SSRN, 2025).